AI Expo Korea 2026 국제인공지능대전 후기

🥑 들어가며

좋은 기회로 회사 차원에서 사전 등록 기회가 있어 AI Expo Korea 2026 국제인공지능대전에 다녀올 수 있었다. 그곳에서 여러 비전과 챗봇에 대해 들을 수 있었는데, 그중 특히 인상 깊었던 주제가 LLM과 추론 인프라, 그리고 AI 반도체에 대한 내용이었다. 이 글은 당시 들은 내용을 바탕으로, LLM이 어떻게 동작하고 왜 앞으로의 경쟁력이 모델 자체보다 추론 비용, 메모리, 전력, 데이터센터 인프라 쪽으로 옮겨가는지를 설명하는 글로 정리해보려 한다.

기가와트 데이터센터 시대의 지속가능한 AI 반도체 솔루션

왜 LLM만 보면 부족한가

이 주제를 이해하려면 먼저 “LLM이 무엇인지”만 보는 것으로는 부족하다. AI가 왜 지금처럼 빠르게 발전했는지, 그리고 앞으로 AI 산업의 핵심 경쟁력이 왜 모델 자체보다 추론 비용, 메모리, 전력, 데이터센터 인프라 쪽으로 이동하는지도 함께 봐야 한다.

AI는 왜 이렇게 빨리 발전했는가

먼저 AI는 최근 수년 동안 지수적으로 발전해왔다. 여기서 지수적 발전이란 성능이 조금씩 선형적으로 좋아지는 것이 아니라, 일정 주기마다 거의 두 배씩 커지는 식의 폭발적인 증가를 의미한다.

예전 AI는 사람이 규칙을 직접 넣어줘야 어느 정도 동작하는 경우가 많았다. 반면 최근 AI는 훨씬 더 큰 데이터와 훨씬 더 많은 연산량을 바탕으로 스스로 패턴을 학습한다. 즉, AI 발전의 핵심은 “사람이 지식을 일일이 넣는 방식”에서 “대규모 데이터와 대규모 연산을 통해 학습시키는 방식”으로 이동했다고 볼 수 있다.

Transformer는 무엇이 달랐는가

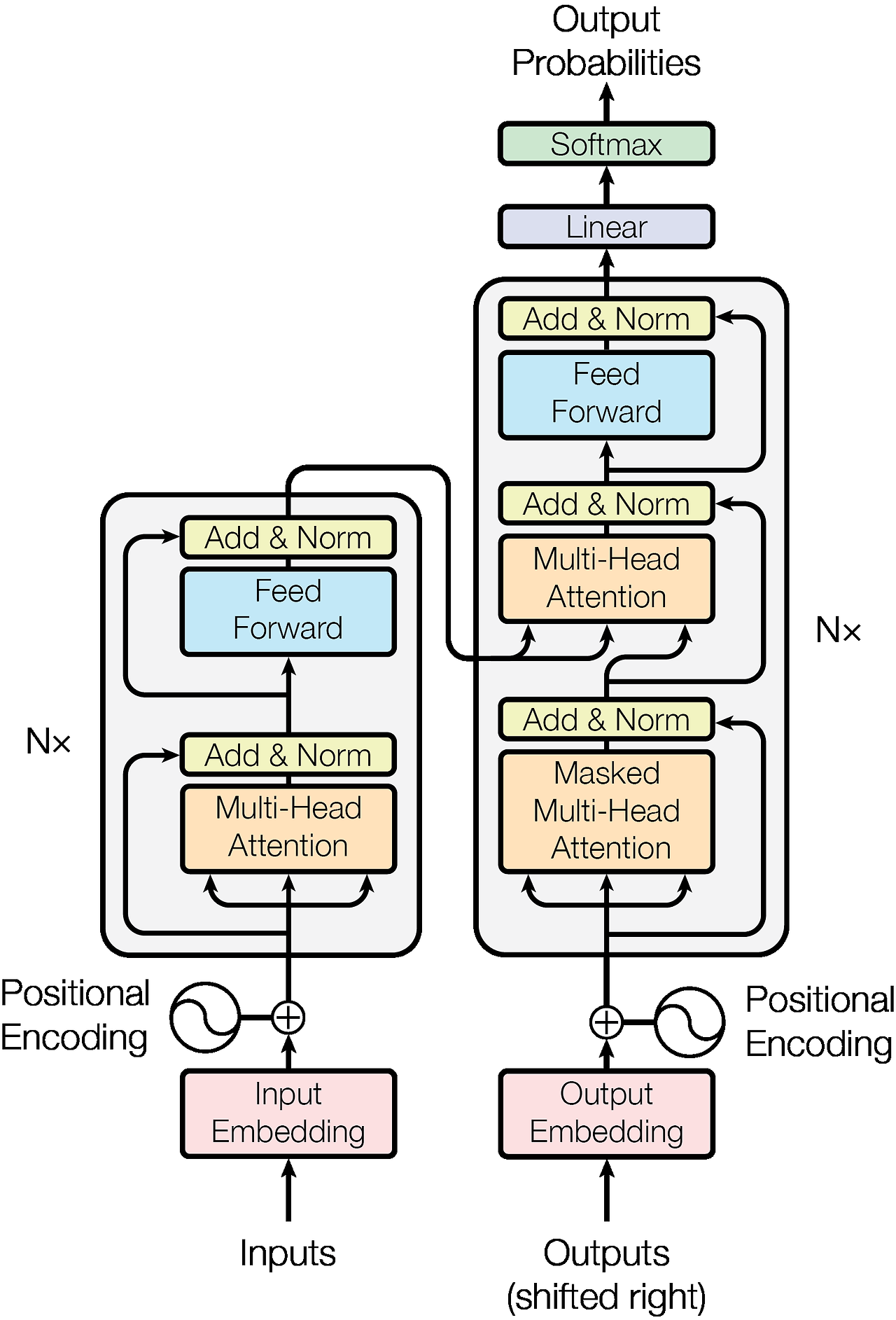

Transformer의 전체 구조는 아래 그림처럼 encoder와 decoder 블록으로 이루어진다.

이 흐름의 중심에는 Transformer가 있다. Transformer는 현재 ChatGPT, Gemini, Claude와 같은 대형 언어 모델의 기반이 되는 구조이다. 이전의 언어 모델들은 문장을 앞에서부터 순서대로 읽는 방식에 가까웠기 때문에, 문장이 길어질수록 앞의 내용을 놓치거나 계산 효율이 떨어지는 문제가 있었다. Transformer는 이 문제를 Attention이라는 개념으로 해결했다.

Attention은 문장 안의 모든 단어를 똑같이 보는 것이 아니라, 현재 단어를 이해하는 데 어떤 단어가 더 중요한지 가중치를 계산하는 방식이다. 자세한 내용은 이 곳에서 볼 수 있다.

예를 들어 GPT 계열 모델은 “오늘 저녁은” 같은 앞 문맥이 주어졌을 때, 그다음에 올 가능성이 높은 토큰을 예측하는 식으로 동작한다. 이처럼 LLM은 기본적으로 다음에 올 단어, 더 정확히는 다음 토큰을 예측하는 방식으로 동작한다.

다만 Attention만으로는 단어의 순서를 자연스럽게 알 수 없기 때문에, Transformer는 보통 positional encoding 같은 방법으로 각 토큰의 위치 정보를 함께 넣어준다. 덕분에 모델은 어떤 단어가 있는지만 보는 것이 아니라, 그 단어가 문장 안에서 어느 위치에 있는지도 함께 참고할 수 있다.

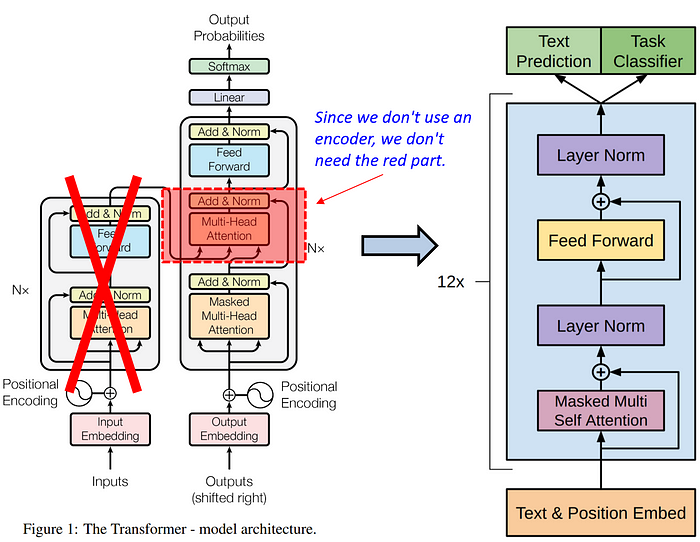

오늘날 생성형 AI에서 많이 쓰이는 GPT 계열은 아래 그림처럼 decoder-only 구조를 사용하는 쪽에 가깝다.

여기서 많은 사람들이 “그럼 LLM은 진짜로 이해하는 걸까, 아니면 그냥 다음 단어만 맞히는 걸까?”라는 질문을 하게 된다. 내부 동작만 놓고 보면 LLM은 확률적으로 다음 토큰을 예측하는 모델이다.

하지만 이 예측을 잘하려면 문맥, 문법, 상식, 코드 구조, 문서 형식 같은 패턴을 매우 넓게 학습해야 한다. 그래서 겉으로 보기에는 이해하고 추론하는 것처럼 보이는 능력이 나타난다. 다만 사람처럼 세계를 직접 경험하고 개념을 자각하는 방식의 “이해”와는 다르기 때문에, 그럴듯하지만 틀린 답을 말하는 환각(Hallucination) 문제도 생긴다.

토큰과 컨텍스트 윈도우

여기서 토큰(Token)은 LLM이 문장을 처리하는 최소 단위이다. 사람이 보기에는 단어 하나처럼 보여도 모델 내부에서는 더 작은 조각으로 나뉠 수 있다. 예를 들어 “안녕하세요”가 하나의 토큰으로 처리될 수도 있고, 여러 조각으로 나뉠 수도 있다.

LLM은 사용자의 질문을 토큰 단위로 쪼개서 이해하고, 답변도 토큰을 하나씩 이어 붙이며 생성한다.

그래서 LLM 비용을 이야기할 때는 입력 토큰 수와 출력 토큰 수가 중요하다. 토큰이 많을수록 계산량이 늘고, 계산량이 늘수록 GPU나 AI 칩이 더 많이 필요하며, 결과적으로 비용과 전력 소모가 증가한다.

LLM을 볼 때 같이 알아두면 좋은 개념이 컨텍스트 윈도우(Context Window) 이다. 이것은 모델이 한 번에 참고할 수 있는 토큰의 최대 길이다.

쉽게 말해 대화 기록, 시스템 프롬프트, 사용자가 붙여 넣은 문서, 그리고 방금 생성 중인 답변까지 포함해서 모델이 “작업 메모리”처럼 들고 갈 수 있는 범위라고 보면 된다. 컨텍스트가 길수록 긴 문서 요약이나 긴 대화를 더 잘 이어갈 수 있지만, 그만큼 메모리 사용량과 추론 비용도 커진다.

참고로 같은 Transformer 계열이라도 모델 구조에 따라 학습 방식은 조금 다르다. GPT는 주로 앞 문맥을 보고 다음 토큰을 예측하는 decoder-only 구조이고, BERT는 문장 중간의 가려진 토큰을 맞히는 encoder-only 구조에 가깝다. 그래서 오늘날 챗봇 형태의 생성형 AI를 설명할 때는 보통 GPT처럼 다음 토큰을 이어서 생성하는 방식을 기준으로 이해하는 편이 자연스럽다.

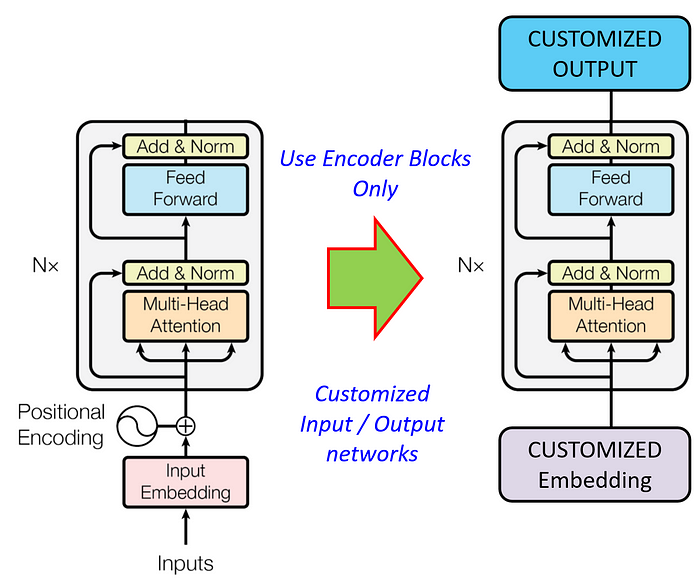

반대로 BERT 계열은 아래 그림처럼 encoder-only 구조에 가깝게 이해할 수 있다.

LLM은 실제로 어떻게 답을 만드는가

LLM의 실제 동작 방식도 여기서 중요하다. 사용자가 질문을 하면 모델은 한 번에 전체 문장을 완성해서 내놓는 것이 아니라, 다음 토큰을 하나 예측하고, 그 결과를 다시 문맥에 포함해 다음 토큰을 예측하는 과정을 반복한다. 즉, 답변 생성은 “한 단어 조각씩” 이어 붙이는 반복 작업에 가깝다.

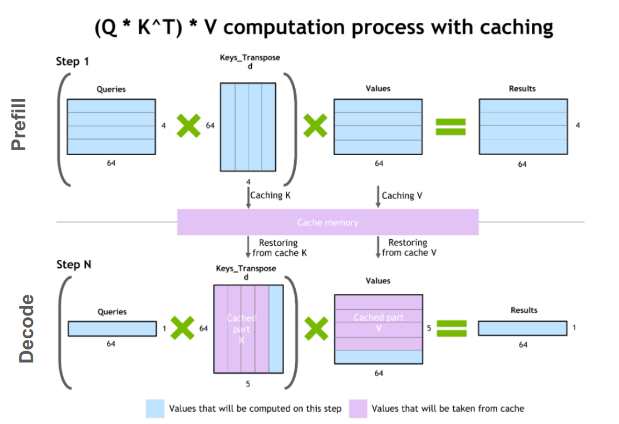

이 과정에서 이전에 계산한 정보를 매번 다시 계산하면 너무 비효율적이기 때문에, 모델은 KV Cache라는 캐시를 사용한다.

아래 그림은 KV Cache가 prefill과 decode 단계에서 어떻게 활용되는지를 보여준다.

KV Cache는 이전 토큰들에 대해 계산해둔 정보를 저장해두는 메모리 공간이다. 조금 더 직관적으로 비유하면, 긴 책을 읽고 질문에 답할 때 이미 읽은 내용을 중간 메모처럼 붙잡아두는 것과 비슷하다.

KV Cache에 대한 자세한 내용은 이 곳에서 볼 수 있다.

왜 메모리가 병목이 되는가

하지만 KV Cache는 동시에 큰 문제를 만든다. 대화가 길어지고, 사용자가 긴 문서를 넣고, 모델이 긴 답변을 생성할수록 KV Cache가 차지하는 메모리가 계속 커진다. 쉽게 말해 LLM은 똑똑해질수록, 그리고 긴 문맥을 다룰수록 메모리를 더 많이 먹는다.

여기서 중요한 것이 Memory Wall, 즉 메모리 병목 문제이다.

- AI 연산은 단순히 계산 장치가 빠르다고 해결되지 않는다.

- 필요한 데이터를 얼마나 빠르게 메모리에서 가져오고 다시 쓸 수 있는지가 성능을 크게 좌우한다.

- 특히 LLM 추론에서는 행렬 곱 같은 대규모 연산도 중요하지만, KV Cache와 메모리 대역폭도 매우 중요한 병목이 된다.

머신러닝에서 딥러닝으로

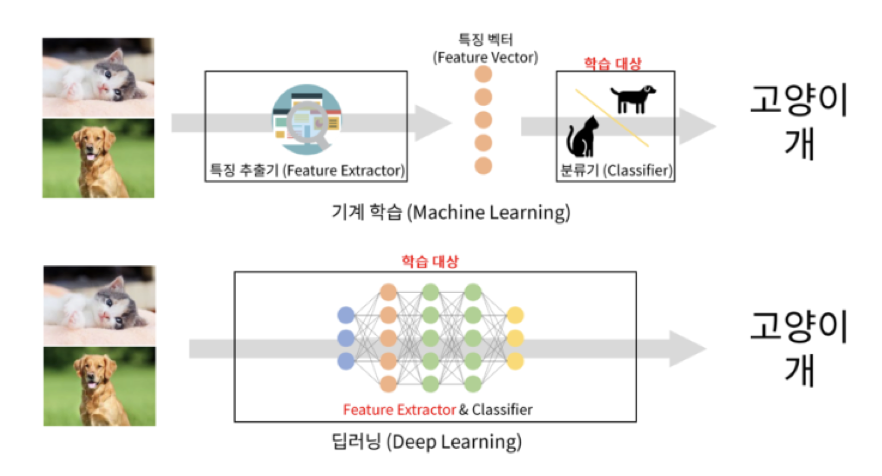

이 차이를 더 이해하려면 전통적인 머신러닝과 딥러닝의 차이도 볼 필요가 있다. 예전 머신러닝에서는 사람이 직접 특징을 설계해야 했다. 예를 들어 고양이를 구분하는 AI를 만든다면 사람이 “귀가 뾰족하다”, “수염이 있다”, “털이 있다” 같은 특징을 정리해서 모델에 알려주는 방식이었다. 반면 딥러닝은 이런 특징을 사람이 직접 지정하지 않아도, 많은 이미지를 학습하면서 모델이 스스로 고양이다운 특징을 찾아낸다. 즉, 사람이 규칙을 직접 넣는 방식에서 벗어나, 데이터와 연산량을 통해 모델이 스스로 패턴을 발견하는 방식으로 바뀐 것이다.

아래 그림은 머신러닝과 딥러닝의 차이를 단순화해서 보여준다.

Bitter Lesson과 Scaling Law

이 맥락에서 자주 언급되는 것이 Bitter Lesson이다. 사람이 정교하게 지식을 넣어 만든 시스템보다, 대규모 연산과 데이터를 활용하는 단순하고 확장 가능한 방법이 장기적으로 더 강력했다는 교훈이다. 체스, 바둑, 비전, 언어 모델 등 여러 분야에서 사람이 도메인 지식을 많이 넣는 접근보다, 더 많은 데이터를 더 큰 모델에 학습시키는 접근이 결국 더 좋은 성능을 냈다.

그래서 AI 발전의 핵심 원리를 다음처럼 요약할 수 있다.

Don't teach, incentivizeScale up

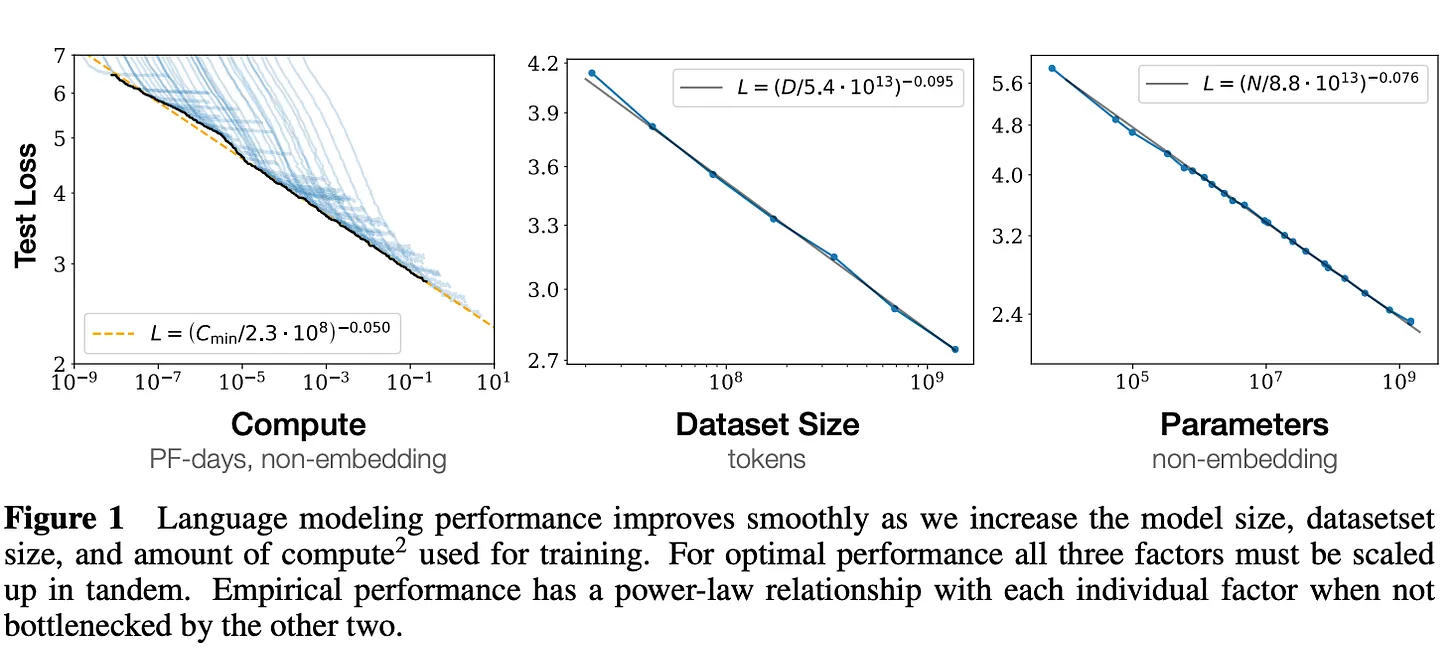

여기서 자주 같이 등장하는 개념이 Scaling Law이다. 모델 파라미터 수, 학습 데이터 양, 연산량을 늘리면 성능이 비교적 예측 가능한 방식으로 좋아진다는 경험 법칙이다. 물론 무한정 좋아지는 것은 아니고, 데이터 품질이나 학습 방법, 비용 한계 같은 현실 제약이 있다. 그래도 최근 LLM 경쟁이 “더 좋은 아이디어 하나”보다 “더 큰 규모를 감당할 자본과 인프라”의 싸움처럼 보이는 이유가 바로 여기에 있다.

아래 그림은 Scaling Law가 연산량, 데이터 크기, 파라미터 수와 성능 사이의 관계를 어떻게 설명하는지 보여준다.

Training보다 Inference가 중요해지는 이유

이 흐름 속에서 AI 시대는 Training의 시대에서 Inference의 시대로 넘어가고 있다.

- Training은 모델을 학습시키는 단계이다. 비유하면 시험 공부를 하는 과정이다.

- Inference는 학습된 모델을 실제 서비스에서 사용해 답변을 생성하는 단계이다. 비유하면 실제 시험 문제를 푸는 과정이다.

과거에는 모델을 얼마나 잘 학습시키느냐, 즉 학습 데이터와 학습 GPU가 중요했다. 하지만 ChatGPT 같은 서비스가 대중화되면서 이제는 수많은 사용자가 매일 질문을 던지고, 모델이 매번 답변을 생성해야 한다. 그러면 학습 한 번의 비용보다 매일매일 발생하는 추론 비용이 더 큰 문제가 된다.

이유는 단순하다. 학습은 아주 비싸더라도 특정 시점에 한 번 또는 가끔 수행하지만, 추론은 사용자가 질문할 때마다 매번 일어난다. 월간 사용자 수가 커질수록 추론은 24시간 계속 돌아가야 하므로, 응답 속도와 서버 비용, 전력 효율이 사업 경쟁력에 직접 연결된다.

특히 모델이 커질수록 추론 비용은 더 커진다. 같은 70B 파라미터급 모델이라도 학습 데이터량이 크게 늘어날 수 있고, 실제 서비스에서 더 많은 요청을 처리해야 하면 추론 인프라의 부담은 계속 증가한다. 그래서 이제 AI 경쟁은 좋은 모델을 만드는 것뿐만 아니라, 그 모델을 얼마나 싸고 빠르고 안정적으로 서비스할 수 있느냐의 경쟁이 된다.

Reasoning Model이 바꾼 것

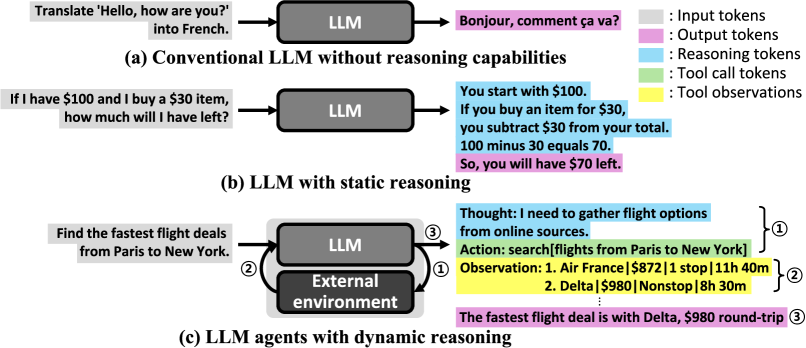

여기에 최근에는 Reasoning Model이라는 흐름이 추가되었다. 기존 LLM은 질문을 받으면 비교적 바로 답을 생성하는 방식에 가까웠다. 반면 OpenAI o1이나 DeepSeek R1 같은 reasoning model은 답을 내기 전에 더 오래 생각하도록 설계되었고, 응답 시점에 더 많은 추론 계산을 사용하는 방향으로 발전하고 있다.

아래 그림은 reasoning model이 대화 turn마다 추론을 거치며 응답을 만드는 흐름을 단순화해서 보여준다.

사람으로 비유하면 단순 암기 문제는 바로 답하지만, 어려운 수학 문제나 코딩 문제는 풀이 과정을 거쳐 답하는 것과 비슷하다. 이 방식은 어려운 문제에서 성능을 높일 수 있지만, 그만큼 비용과 지연 시간도 함께 증가한다. 그래서 Test-time Compute, 즉 답변을 생성하는 시점에 쓰는 연산량이 더 중요해진다.

이때 중요한 점은 “모델이 똑똑하다”는 것이 단순히 파라미터 수만의 문제가 아니라는 것이다. 같은 기반 모델이라도 얼마나 오래 생각하게 만들지, 도구를 쓰게 할지, 여러 번 후보 답을 비교하게 할지에 따라 성능과 비용이 함께 달라진다. 즉 앞으로는 큰 모델 하나를 만드는 것만이 아니라, 그 모델을 어떤 추론 전략으로 운영할지도 핵심 기술이 된다.

Agent는 무엇이 다른가

이후에는 Agent의 시대를 함께 보게 된다. Agent는 단순히 질문에 답하는 AI가 아니라, 외부 도구를 사용하고, 계획을 세우고, 결과를 관찰한 뒤 다시 행동하는 AI를 의미한다. 예를 들어 사용자가 “서울에서 다음 주에 갈 만한 AI 컨퍼런스를 찾아서 일정에 추가해줘”라고 말했을 때, 단순 LLM은 텍스트 답변만 할 수 있지만 Agent는 검색 도구를 호출하고, 날짜를 비교하고, 캘린더 API를 호출해 일정을 추가하는 식으로 행동할 수 있다.

일반 LLM과 agent의 차이를 비교하면 아래와 같이 정리할 수 있다.

이런 구조를 설명할 때 자주 나오는 것이 ReAct 패턴이다. ReAct는 Reasoning과 Acting의 조합으로, AI가 생각하고, 행동하고, 관찰하고, 다시 생각하는 루프를 반복한다.

아래 그림은 ReAct가 reasoning과 action을 결합한 루프라는 점을 보여준다.

이 흐름을 종합하면 AI는 다음과 같이 발전한다고 볼 수 있다.

- 대화형 챗봇

- 문제 해결 능력이 강화된 Reasoner

- 실제 행동을 수행하는 Agent

- 발명과 창조를 돕는 Innovator

- 조직 단위 업무를 수행하는 AI

결국 AI는 단순히 “말을 잘하는 프로그램”에서 “복잡한 문제를 풀고 실제 일을 처리하는 시스템”으로 진화하고 있다고 볼 수 있다.

왜 데이터센터가 중요해지는가

그런데 이런 발전은 엄청난 인프라 비용을 동반한다. Reasoning 모델은 더 오래 생각해야 하고, Agent는 여러 번 도구를 호출하며 반복 추론을 해야 한다. 사용자는 더 긴 문서를 넣고, 더 긴 답변을 기대한다.

그러면 필요한 GPU, 메모리, 네트워크, 전력, 냉각 비용이 모두 증가한다.

그래서 앞으로는 단순한 서버 몇 대가 아니라 기가와트급 전력을 사용하는 초대형 AI 데이터센터가 중요해진다. Microsoft, OpenAI, Meta, xAI 같은 기업들이 대규모 데이터센터를 구축하는 이유도 여기에 있다.

GPU 다음으로 왜 추론 특화 칩이 나오는가

하지만 기존 GPU 기반 인프라는 비싸고 전력 소모가 크다. GPU는 원래 그래픽 처리에서 출발한 범용 병렬 연산 장치이고, AI 학습과 추론에도 매우 강력하지만, 모든 면에서 최적은 아니다. 특히 대규모 LLM 추론에서는 메모리 대역폭, KV Cache 저장, 전력 효율, 비용이 큰 문제가 된다.

그래서 최근에는 GPU 대신 LLM 추론에 특화된 전용 반도체가 대안으로 제시된다. 일부 업체는 이런 칩을 LPU라고 부르는데, 여기서는 추론을 더 싸고 전력 효율적으로 수행하기 위한 전용 칩 정도로 이해하면 된다.

LPDDR과 데이터 흐름 최적화

추론 특화 반도체가 내세우는 차별점은 크게 메모리 선택, 데이터 흐름 최적화, 그리고 사용성으로 나눌 수 있다.

먼저 LPDDR 메모리 사용이다. 기존 고성능 GPU는 주로 HBM이라는 고대역폭 메모리를 사용한다. HBM은 매우 빠르지만 가격이 비싸고 전력 소모가 크다. 반면 LPDDR은 스마트폰이나 모바일 기기에서 많이 쓰이는 저전력 메모리이다. 일반적으로 HBM보다 대역폭은 낮지만, 저렴하고 전력 효율이 좋다.

따라서 LLM 추론에서는 무조건 가장 비싼 HBM을 쓰는 것보다, 구조를 잘 설계해서 LPDDR을 효율적으로 활용하는 편이 비용과 전력 측면에서 유리할 수 있다는 관점이 나온다.

다음은 Streamlined Dataflow Architecture이다. 아래 사진은 세미나에서 찍은 사진이다.

일반 GPU는 범용성이 높지만, 그만큼 데이터가 여러 계층의 메모리와 연산 유닛 사이를 이동하는 과정이 복잡하다. 데이터 이동은 생각보다 큰 비용이다.

연산 자체보다 데이터를 가져오고 옮기는 데 더 많은 전력과 시간이 들 수도 있다.

추론 특화 칩은 보통 다음 방향을 지향한다.

- LLM 추론에 필요한 데이터 흐름을 단순화한다.

- 한 번 가져온 데이터를 최대한 재사용한다.

- 메모리 대역폭 효율을 높인다.

쉽게 말하면, GPU가 “여러 일을 다 잘하는 범용 장비”라면, LPU는 “LLM 추론이라는 특정 작업을 싸고 효율적으로 처리하기 위한 전용 장비”에 가깝다.

마지막은 SDK와 사용성이다. 아무리 좋은 칩을 만들어도 개발자가 쓰기 어렵다면 채택되기 어렵다. 그래서 추론 반도체는 PyTorch, HuggingFace, vLLM 같은 기존 LLM 개발 생태계와 유사한 사용 경험을 제공하려고 한다.

개발자 입장에서는 기존 GPU 기반 워크플로우를 크게 바꾸지 않고도 새로운 하드웨어를 사용할 수 있어야 한다. 즉, 하드웨어만 좋은 것이 아니라 소프트웨어 스택까지 같이 제공해야 실제 데이터센터와 서비스 환경에서 사용할 수 있다는 의미이다.

Disaggregation은 왜 필요한가

마지막으로 Disaggregation도 중요하다. 이는 하나의 거대한 장비가 모든 일을 처리하는 방식이 아니라, LLM 추론 과정을 기능별로 나누어 최적화하는 접근이다. 예를 들어 prefill 단계와 decode 단계는 성격이 다르다. Prefill은 사용자가 입력한 긴 프롬프트를 한 번에 처리하는 단계이고, decode는 답변 토큰을 하나씩 생성하는 단계이다.

아래 그림은 prefill과 decode를 분리해 처리하는 구조를 보여준다.

두 단계를 비교하면 다음과 같다.

- prefill은 “문제를 처음 읽고 이해하는 구간”에 가깝다.

- decode는 “답을 한 줄씩 써 내려가는 구간”에 가깝다.

- prefill은 한 번에 많은 토큰을 처리한다.

- decode는 한 번에 한 토큰씩 생성한다.

- 그래서 두 단계를 같은 방식으로 처리하는 것보다 분리해서 최적화하는 편이 효율적일 수 있다.

PD/AF disaggregation 같은 표현도 이런 맥락에서 이해할 수 있다. 더 자세한 내용은 이 곳에서 볼 수 있다.

마무리

정리하면 이 주제의 핵심은 분명하다. 이제 AI 경쟁은 단순히 더 큰 모델을 만드는 것에 머무르지 않는다. 앞으로는 그 모델을 얼마나 효율적으로 추론하고, 얼마나 안정적으로 서비스하고, 그 비용을 얼마나 감당 가능한 수준으로 낮출 수 있는지가 더 중요해진다.

결국 LLM의 미래는 모델 성능만이 아니라, 그것을 뒷받침하는 메모리 구조, 추론 비용, 전력 효율, 데이터센터, 그리고 추론 특화 반도체까지 함께 봐야 이해할 수 있다.

느낀점

이번 세미나를 들으면서 가장 크게 느낀 점은, 내가 그동안 AI를 너무 모델 중심으로만 보고 있었다는 점이다. 전시장에서는 다양한 서비스와 데모가 눈에 먼저 들어왔지만, 막상 가장 오래 기억에 남은 것은 화면에 보이는 결과보다 그 결과를 가능하게 만드는 추론 비용과 인프라 이야기였다.

현장에서 여러 부스를 둘러볼 때는 자연스럽게 “무엇을 할 수 있는가”에 시선이 갔다. 그런데 이 세션을 듣고 나서는 “이 기능을 실제로 얼마나 오래, 얼마나 싸게, 얼마나 안정적으로 운영할 수 있는가”라는 질문이 더 크게 남았다.

평소에는 어떤 모델이 더 똑똑한지, 어느 서비스가 더 답변을 잘하는지 같은 부분에만 관심이 갔는데, 실제 산업 관점에서는 그 모델을 얼마나 빠르고 안정적으로, 그리고 감당 가능한 비용으로 서비스할 수 있는지가 훨씬 더 중요한 문제라는 점이 인상적으로 다가왔다.

특히 LLM이 똑똑해질수록 단순히 “좋은 모델이 나왔다”에서 끝나는 것이 아니라, 그 뒤에서 더 많은 메모리와 더 많은 전력, 더 큰 데이터센터가 필요해진다는 점이 현실적으로 느껴졌다. 모델 성능 향상만 보면 기술 발전처럼 보이지만, 그 성능을 실제 서비스로 유지하려면 결국 반도체와 인프라 문제가 같이 따라온다는 점이 흥미로웠다.

또 하나 인상 깊었던 점은 앞으로의 AI 경쟁이 소프트웨어 회사들끼리의 경쟁만은 아니라는 것이다. 이제는 GPU, 메모리, 전력 효율, 냉각, 데이터센터 설계 같은 요소까지 전부 연결되어 있기 때문에, AI는 생각보다 훨씬 더 넓은 산업과 맞물려 움직이고 있다는 느낌을 받았다.

특히 다른 세션들이 비교적 서비스나 활용 사례 중심으로 보였다면, 이 세션은 그 뒤에 있는 기반 기술을 정면으로 보여줬다는 점에서 더 인상 깊었다. 화려한 데모보다도 “이 기술을 실제로 굴리려면 무엇이 필요한가”를 묻는 시선이 더 오래 남았다.

단순히 챗봇이나 생성형 AI 서비스를 보는 것과, 그 서비스를 가능하게 만드는 기반 기술을 같이 보는 것은 완전히 다른 시야라는 생각도 들었다.

결국 이번 AI Expo에서 가장 오래 남은 것은 “어떤 AI가 더 잘 말하느냐”보다 “그 AI를 앞으로 누가 더 효율적으로 굴릴 수 있느냐”라는 질문이었다. LLM을 잘 모르는 사람에게는 모델 자체가 가장 커 보일 수 있지만, 조금만 더 들여다보면 결국 성능 뒤에는 인프라와 비용의 문제가 있고, 앞으로 AI 산업의 승부처도 그 지점에 있을 수 있겠다는 생각이 들었다.